文青風盛行,逛展覽時很常遇到擺攤賣似顏繪的畫家。似顏繪不求相機般的真實肖像畫,而是要精確捕捉到模特兒的個人特色。中國有位主人不小心弄丟狗狗,竟然在尋狗啟事放似顏繪版插圖。由於畫風相當潦草,被網友們嘲笑沒人能按圖找回狗狗,沒想到小貴賓本尊現身後,突然一切都合理了。

翻攝自《新浪新聞》,下同

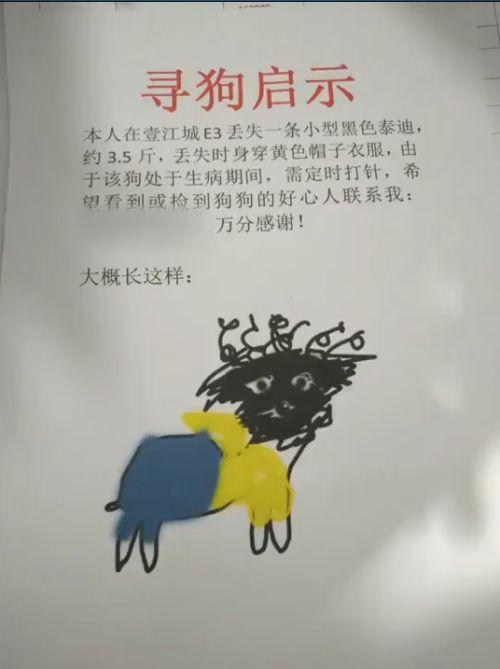

根據《重慶商報》報導,重慶市江北區石馬河一位主人心急如焚,因為她家的黑色貴賓狗跟著鄰居進電梯後走丟了。飼主趕著印尋狗啟事,但中途斷網傳不了照片,她乾脆放手繪圖說明「大概長這樣」。因為狗狗生病需要定時打針,所以主人希望能盡快找回愛犬。

尋狗啟事貼在社區電梯和大廳,圖上一團像黑毛線的卡通版狗狗,穿著有黃帽子的藍色小衣服,讓網友們忍不住開酸:「這個也畫得太抽象了吧……是要怎麼找啦」、「其實妳沒打算真的把狗狗找回來吧?」、「懷疑狗狗是因為嫌棄主人才離家出走」、「靈魂畫風,祝你真的能找到狗」、「算了吧,把自己狗畫成這樣是誰找得到」。

幸好鄰居很快就幫忙找回愛犬,小貴賓本尊照片曝光後,竟然跟主人的手稿有幾分相似。這張尋狗啟事爆紅後,主人也接受採訪,直言爆紅原因應該是狗狗「長得太醜了」。聽到有人評論插畫的風格迷幻,主人笑說:「我覺得可能是牠長得比較迷幻。」說不定主人真的只是畫下自己眼中的毛孩而已XD 你認為這個主人視角和實際狗狗有像嗎?

感謝參與!

投票結果與分析已在文末解鎖

在這個快速發展的人工智慧時代,我們面臨著一項極具深度的倫理抉擇:為了推動科技的飛躍,我們是否願意在個人隱私上做出讓步?這項看似簡單的選擇,實則觸及了個人權利、社會價值與未來發展的複雜交織。讓我們深入探討這兩種觀點背後所蘊含的深層意義。

「是,為了進步」:前瞻者的數據願景

選擇「是,為了進步」的群體,展現了一種對未來科技發展的樂觀與積極態度。他們深信,人工智慧的潛力無可限量,能夠在諸多關鍵領域,如醫療診斷、教育革新、智慧交通乃至前沿科學研究中,扮演關鍵的推動者,甚至解決目前看似無解的難題。

對他們而言,數據是架構起人工智慧龐大體系的基石。他們理解,要訓練出更精準、更可靠的AI,就必須有高品質、大規模的數據作為燃料。因此,他們願意以部分個人隱私的讓渡,來換取AI技術的加速成熟與進步。這種思維模式,也常伴隨著對AI開發者(無論是企業或研究機構)的信任,相信他們會負責任地使用數據,並將其應用於造福社會的目標。

這類型的思考者,傾向於一種權衡取捨的智慧。他們認為,在某些情況下,個人的隱私犧牲,相較於AI帶來的集體福祉,是值得的。這是一種「小我」服從於「大我」的格局,或是對未來效益的一種前瞻性投資。即便如此,這並不代表他們對隱私風險毫無察覺,而是相信透過技術手段(如匿名化、去識別化)可以將風險降至最低,或是願意承擔一定的風險以換取更大的整體利益。

為何他們如此選擇?

- 參與塑造AI的未來: 透過提供數據,他們實際上參與了AI發展方向的定義,使其更貼近真實世界的應用需求。

- 推動更精準的AI服務: 更全面的數據能讓AI提供更個人化、更精準的服務,從而提升生活品質。

- 促進AI的安全性與可靠性: 更多的數據有助於發現和修復AI中的偏見和錯誤,使其更加安全可靠。

- 對新技術的開放態度: 這反映了一種對新技術的探索精神和開放態度,願意嘗試並適應新的科技發展模式。

「否,隱私至上」:守護個人疆界的決心

相對地,選擇「否,隱私至上」的群體,將個人隱私視為一項不可動搖的基本人權。他們堅信,隱私是個人尊嚴和自主性的核心,不應以任何理由被交易或犧牲。

他們對數據被濫用、洩露、監控或用於非預期目的的可能性,保持高度警惕。過往的數據洩露事件,或是對數位監控的擔憂,讓他們對此採取了最審慎的態度。同時,他們也對目前以大量數據驅動的AI發展模式,提出質疑。他們認為,這種模式過度依賴對個人數據的獲取,而忽略了其他更具可持續性與倫理性的發展路徑。

更重要的是,他們質疑以犧牲個人基本權利為代價的「進步」,是否真正值得追求。他們更關注技術發展是否符合倫理原則,是否能真正造福所有人,而非僅僅是技術上的突破。對他們而言,個人擁有決定自身數據如何被使用的權利,不希望被動地被數據收集與分析。

這個選擇對個人意味著:

- 堅守個人原則: 他們選擇捍衛自己的隱私權,不願為此妥協。

- 保持警惕: 他們對數位時代的隱私風險保持高度警惕,並可能採取更積極的措施來保護自己的數據。

- 尋求其他解決方案: 他們可能更傾向於支持那些強調隱私保護的 AI 技術或解決方案。

對整體社群的意義:一次深刻的價值觀對話

無論哪種選擇佔據多數,這項調查結果都揭示了社會在面對AI發展時,所面臨的深刻倫理困境與價值觀衝突。這不僅是一次技術選擇,更是一場關於我們希望建構怎樣社會的對話。

- 對話的契機: 這促使社群成員開始更廣泛地討論AI倫理、數據主權、隱私保護以及技術發展的邊界。

- 政策制定的參考: 這種民意調查結果可以為政府、監管機構和產業制定相關政策和規範提供重要的參考依據,例如在數據保護法規、AI倫理準則等方面。

- 技術發展的方向: 它提醒AI開發者,在追求技術進步的同時,必須認真考慮公眾的隱私擔憂,並努力尋找平衡點,開發更具隱私保護意識的技術。

- 教育和意識提升: 這有助於提升公眾對AI發展及其對個人隱私影響的認知,鼓勵大家更積極地參與到相關的討論和決策中。

跨文化視角:隱私觀念的多元光譜

不同國家和文化在隱私觀念和對科技發展的態度上存在差異,這也會影響他們對此類問題的看法。這就像一張多元的色譜,反映了全球社會在隱私議題上的不同色彩。

文化差異的影響:

- 集體主義 vs. 個人主義: 在一些集體主義文化中,人們可能更傾向於為了集體利益(例如國家發展、社會進步)而犧牲部分個人權利,這可能使得「是,為了進步」的比例相對較高。而在一些個人主義文化中,個人權利和自由的價值被高度重視,人們對個人隱私的保護會更加嚴格,這可能使得「否,隱私至上」的比例相對較高。

- 法律與監管環境: 擁有嚴格隱私法規的國家或地區,其公民對個人數據的保護有更高的意識和期望,因此更傾向於選擇「否」。反之,在數據監管較寬鬆的國家,人們可能更容易接受數據共享。

- 信任水平: 公眾對政府處理個人數據的透明度和可信度,以及企業對數據保護的承諾,會極大地影響他們的選擇。在高信任度的環境中,人們可能更願意分享數據。

- 科技普及程度與經驗: 經歷過大規模數據洩露或監控醜聞的國家,其公民的隱私敏感度會更高。科技越普及,人們對數據的熟悉度越高,也可能對隱私問題有更深入的思考。

總體而言,這項調查反映了全球社會在AI時代面臨的共同挑戰:如何在追求科技進步的同時,有效保護個人隱私,並在兩者之間找到一個可持續的平衡點。不同文化和國家可能會呈現出不同的側重點和選擇傾向,這也正是我們需要深入理解和尊重的多元性。

這篇分析對你有幫助嗎?

(往下還有更多精彩文章!)